Photo: Samuel Zeller | Unsplash

Facebook, Twitter, Youtube and Google+ have published the legally required transparency reports under the Network Enforcement Act (NetzDG). The figures refer to the period from January 1 to June 30, 2018.

All platforms provide information on the number of complaints submitted under the new law. Complaints can be filed by individual users as well as independent complaints offices. In addition, the number of content deleted or blocked for users in Germany and the size of the teams responsible for moderation are disclosed.

Youtube

Number of complaints: 214.827 (Users: 144.836 | Complaints offices: 69.991)

Number of removed/blocked contents: 58.297 (Users: 42.025 | Complaints offices: 16.272)

At Youtube, all content reported in accordance with the Network Enforcement Act is checked for the 22 criminal offences contained in the law and for the community guidelines. The latter is done in the first step. Subsequent checking is carried out in accordance with NetzDG. If the reported content violates the Platform Guidelines, it will be deleted. Contents that are classified as illegal after one of the 22 offences are blocked for users in Germany. Google+, Facebook and Twitter also follow this path.

Google+ and Youtube share a moderation team of about 100 people. A service provider was hired for these complaints specifically. The two Google networks go a different way in the reporting process compared to the other platforms: The 22 offences summarised in the Network Enforcement Act have been divided into seven categories. Google justifies this with a simplification for the reporting users. Individual laws can appear in several categories.

Youtube uses various mechanisms to detect illegal content and violations of its own guidelines. This includes the use of hashes for automatic detection of terrorist and child pornographic content that has already been blocked, machine learning for automated detection of extremist content and content reported by users.

In most cases where action was taken after a report, content was deleted globally because it violated community policies. The lower share was withheld in Germany according to the NetzDG. However, this does not mean that a proportion of the deleted content was not also illegal. The moderators only check for these violations in the first step.

Source: Google

Google+

Number of complaints: 2.769 (Users: 2.741 | Complaints offices: 28)

Number of removed/blocked contents: 1.277 (Users: 1.257 | Complaints offices: 20)

Google+ has more than 2 million registered users in Germany and thus falls under the Network Enforcement Act. However, the number of active users is likely to be significantly lower. You automatically get a Google+ account when you create a Google Account, for example to use YouTube or Google Docs.

Since complaints on YouTube and Google+ are handled by the same moderation team, all procedures are the same.

Source: Google

Number of complaints: 886 (Users: 773 | Complaints offices: 113)

Number of reported content: 1.704

Number of removed/blocked contents: 362

On Facebook, as on the other platforms, several items can be reported at once as a violation of the Network Enforcement Act. However, only Facebook makes a distinction between complaints (a total of 886) and the number of reported content (a total of 1,704).

According to the company, Facebook’s moderation team consists of about 65 people. In the first step, reports are checked at Facebooks‘ German service partner Arvato. If not removed in accordance with community guidelines, all cases will be reported to the Legal Takedown Request Operations Team, who will check the content for violations. In unclear cases, internal company lawyers are consulted.

Facebook writes about the multilingualism of the moderation team:

The members of the team have a wide range of linguistic skills, including German, English, French, Turkish and Arabic, to take account of the linguistic diversity of the German population.

The 2 to 3 million people in Germany who speak Russian remain unmentioned.

The low number of complaints, especially in comparison to YouTube and Twitter, can be explained by Facebook’s reporting procedures for complaints according to the Network Enforcement Law. While complaints on YouTube can be reported directly via the familiar reporting function next to videos and comments, Facebook users must use another form that cannot be accessed directly via the posts or comments.

Source: Facebook | Facebook’s NetzDG reporting form

Number of complaints: 264.818 (Users: 244.064 | Complaints offices: 20.754)

Number of removed/blocked contents: 28.665 (Users: 27.112 | Complaints offices: 1.533)

Twitter also checks messages for violations of community guidelines and the NetzDG and deletes or blocks them for users in Germany.

At Twitter about 50 people are working on the handling of complaints. Most of the content complained about was reported as incitement to hatred.

Source: Twitter

Reports are hard to compare

On all four platforms, complaints about several contents can be summarized in one message. However, because only Facebook provides information about the number of complaints and additionally the number of reported content, a comparison between the platforms is difficult. If the average user reports one video on YouTube, but the average Twitter user reports three tweets, the ratio between messages and measures would look significantly different.

| Youtube | Google+ | |||

| Complaints | 214.827 | 2.769 | 886 | 264.818 |

| Number of removed/blocked contents | 58.297 | 1.277 | 362 | 28.665 |

The ratio of the responsible moderators to complaints to be dealt with is interesting as well: Youtube and Google+ share a moderation team of about 100 people to handle complaints according to the NetzDG. The total number of complaints is 217,596 in the period from January to the end of June 2018. 65 people are employed by Facebook dealing with complaints under the Network Enforcement Act. The total number of complaints on Facebook was 886. Twitter had 50 people handling a total of 264,818 complaints.

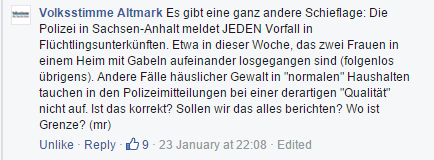

The scope of the transparency reports varies considerably. The documentation of Google+ and Youtube also includes a number of examples of reported content. For example, a speech by Angela Merkel was reported as both a terrorist content and hate speech. In the video she talks about the role of Islam in Germany. Youtube’s less surprising decision: The video is still available in Germany.

Twitter’s report is the shortest: Its ten pages are filled with a whole collection of large screenshots explaining the reporting procedure.

A ranking of reports by word count:

Youtube 5.525

Facebook 3.624

Google+ 3.118

Twitter 969

It seems that the Federal Ministry of Justice has not given any concrete guidelines for the presentation of the figures, so that the transparency reports come out quite differently. In order to be able to compare the figures between the platforms, some effort is necessary in each case. Twitter’s overview of the reported content for each offence has been included as an image in the report, which makes it unsearchable. In the case of Youtube and Google+, it is not possible to draw any conclusions about the decisions after the respective criminal offence.

Reported violations at a glance

Youtube

| Complaints | Removed & blocked content | |

| Hate speech/Political extremism | 75.892 | 24.804 |

| Personality rights violation or insult | 45.190 | 11.428 |

| Pornographic content | 27.308 | 7.338 |

| Inappropriate or dangerous content | 22.813 | 2.765 |

| Violence | 21.349 | 3.964 |

| Privacy | 12.460 | 4.673 |

| Terrorist or unconstitutional content | 9.815 | 3.325 |

Google+

| Complaints | Removed & blocked content | |

| Hate speech/Political extremism | 1.121 | 554 |

| Personality rights violation or insult | 564 | 196 |

| Terrorist or unconstitutional content | 409 | 245 |

| Pornographic content | 249 | 121 |

| Privacy | 153 | 35 |

| Violence | 138 | 77 |

| Inappropriate or dangerous content | 135 | 49 |

| Paragraph | Complaints | Removed & blocked content |

| Insult (§ 185) | 460 | 114 |

| Defamation (§ 186) | 407 | 90 |

| Intentional Defamation (§ 187) | 342 | 66 |

| Incitement to hatred (§ 130) | 247 | 74 |

| Public incitement to crime (§ 111) | 123 | 26 |

| Threatening the commission of a felony (§ 241) | 119 | 31 |

| Rewarding and approving of offences (§ 140) | 95 | 21 |

| Violation of intimate privacy by taking photographs (§ 201a) | 95 | 16 |

| Defamation of religions, religious and ideological associations (§ 166) | 92 | 24 |

| Dissemination of depictions of violence (§ 131) | 86 | 18 |

| Breach of the public peace by threatening to commit offences (§ 126) | 83 | 16 |

| Using symbols of unconstitutional organisations (§ 86a) | 66 | 21 |

| Dissemination of propaganda material of unconstitutional organisations (§ 86) | 64 | 13 |

| Forgery of data intended to provide proof (§ 269) | 56 | 3 |

| Forming of criminal or terrorist organisations (§§ 129 – 129b) | 30 | 0 |

| Treasonous Forgery (§ 100a) | 27 | 1 |

| Encouraging the commission of a serious violent offence endangering the state (§ 91) | 26 | 1 |

| Preparation of a serious violent offence endangering the state (§ 89a) | 24 | 2 |

| Distribution, acquisition and possession of child pornographic writings (§ 184b in conjunction with § 184d) | 19 | 0 |

| Paragraph | Complaints | Removed & blocked content |

| Incitement to hatred (§ 130) | 82.095 | 10.191 |

| Insult (§ 185) | 75.925 | 4.882 |

| Defamation (§ 186) | 16.474 | 503 |

| Public incitement to crime (§ 111) | 12.179 | 2.363 |

| Defamation of religions, religious and ideological associations (§ 166) | 10.867 | 943 |

| Intentional Defamation (§ 187) | 10.082 | 309 |

| Threatening the commission of a felony (§ 241) | 8.241 | 1.323 |

| Dissemination of propaganda material of unconstitutional organisations (§ 86) | 7.416 | 1.019 |

| Using symbols of unconstitutional organisations (§ 86a) | 6.505 | 2.522 |

| Violation of intimate privacy by taking photographs (§ 201a) | 6.034 | 242 |

| Forming of criminal or terrorist organisations (§§ 129 – 129b) | 5.770 | 840 |

| Distribution, acquisition and possession of child pornographic writings (§ 184b in conjunction with § 184d) | 4.846 | 1.505 |

| Rewarding and approving of offences (§ 140) | 4.394 | 619 |

| Breach of the public peace by threatening to commit offences (§ 126) | 4.254 | 539 |

| Dissemination of depictions of violence (§ 131) | 3.719 | 513 |

| Forgery of data intended to provide proof (§ 269) | 2.167 | 21 |

| Preparation of a serious violent offence endangering the state (§ 89a) | 1.257 | 143 |

| Treasonous Forgery (§ 100a) | 1.170 | 21 |

| Encouraging the commission of a serious violent offence endangering the state (§ 91) | 933 | 147 |

German version here.